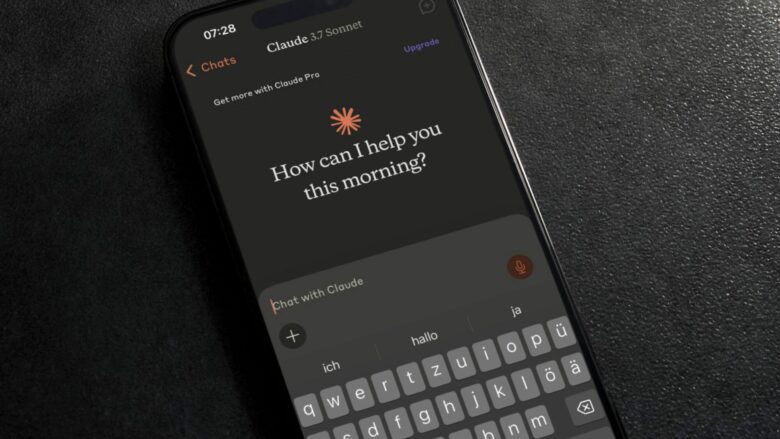

Anthropic wird User-Chats zum Trainieren seiner AI-Modelle verwenden

Anthropic führt Änderungen an seinen Nutzungsbedingungen und Datenschutzrichtlinien ein, die es dem Unternehmen ermöglichen, Nutzerdaten für das Training seiner KI-Modelle zu verwenden. Wie The Verge berichtet, wird Anthropic künftig neue Chat-Transkripte und Coding-Sessions für das Training nutzen, sofern Nutzer nicht aktiv widersprechen. Das Unternehmen erklärt: „Wir geben Nutzern jetzt die Wahl, ob ihre Daten zur Verbesserung von Claude und zur Stärkung unserer Schutzmaßnahmen gegen schädliche Nutzung wie Betrug und Missbrauch verwendet werden dürfen.“

Die Änderungen betreffen Nutzer der Claude Free-, Pro- und Max-Pläne, einschließlich der Nutzung von Claude Code über Konten, die mit diesen Plänen verknüpft sind. Nicht betroffen sind Dienste unter den kommerziellen Bedingungen, darunter Claude for Work, Claude Gov, Claude for Education oder API-Nutzung, auch nicht über Drittanbieter wie Amazon Bedrock und Google Cloud’s Vertex AI. Anthropic betont den Nutzen der Datenfreigabe: „Durch die Teilnahme helfen Sie uns, die Modellsicherheit zu verbessern, indem unsere Systeme zur Erkennung schädlicher Inhalte genauer werden und harmlose Gespräche mit geringerer Wahrscheinlichkeit markieren.“

Verlängerte Datenspeicherung und Nutzeroptionen

Parallel zur Datennutzung für das Training verlängert Anthropic die Datenspeicherfrist von 30 Tagen auf fünf Jahre für Nutzer, die der Datenverwendung zustimmen. „Wir verlängern auch die Datenspeicherung auf fünf Jahre, wenn Sie uns erlauben, Ihre Daten für das Modelltraining zu verwenden“, erklärt das Unternehmen. Diese verlängerte Speicherdauer gilt nur für neue oder fortgesetzte Chats und Coding-Sessions sowie für Feedback, das Nutzer zu Claudes Antworten geben. Wenn Nutzer ein Gespräch mit Claude löschen, wird es nicht für zukünftiges Modelltraining verwendet.

Bestehende Nutzer haben bis zum 28. September 2025 Zeit, die aktualisierten Nutzungsbedingungen zu akzeptieren und ihre Entscheidung zu treffen. Bei Akzeptanz treten die neuen Richtlinien sofort in Kraft. Nach dem Stichtag müssen Nutzer ihre Auswahl zur Modelltrainingseinstellung treffen, um Claude weiterhin nutzen zu können. Die Einstellungen können jederzeit in den Datenschutzeinstellungen geändert werden.

Datenschutz und Sicherheitsmaßnahmen

Zum Schutz der Privatsphäre setzt Anthropic eine Kombination aus Tools und automatisierten Prozessen ein, um sensible Daten zu filtern oder unkenntlich zu machen. Das Unternehmen betont, dass es die Nutzerdaten nicht an Dritte verkauft. Die neuen Richtlinien gelten ausschließlich für neue oder fortgesetzte Chats und Coding-Sessions – bestehende Gespräche werden nicht für das Training verwendet, es sei denn, der Nutzer setzt diese fort.

Neuen Nutzern wird die Wahlmöglichkeit während des Registrierungsprozesses angeboten, während bestehende Nutzer über ein Pop-up-Fenster informiert werden. Anthropic stellt klar, dass die Nutzer stets die Kontrolle über diese Einstellung behalten und selbst entscheiden können, ob ihre Daten auf diese Weise verwendet werden dürfen. Wer sich gegen die Datennutzung für das Training entscheidet, behält die bestehende 30-tägige Datenspeicherfrist bei.