Anthropic launcht Claude 3.5, will Top-Modelle von OpenAI und Google schlagen

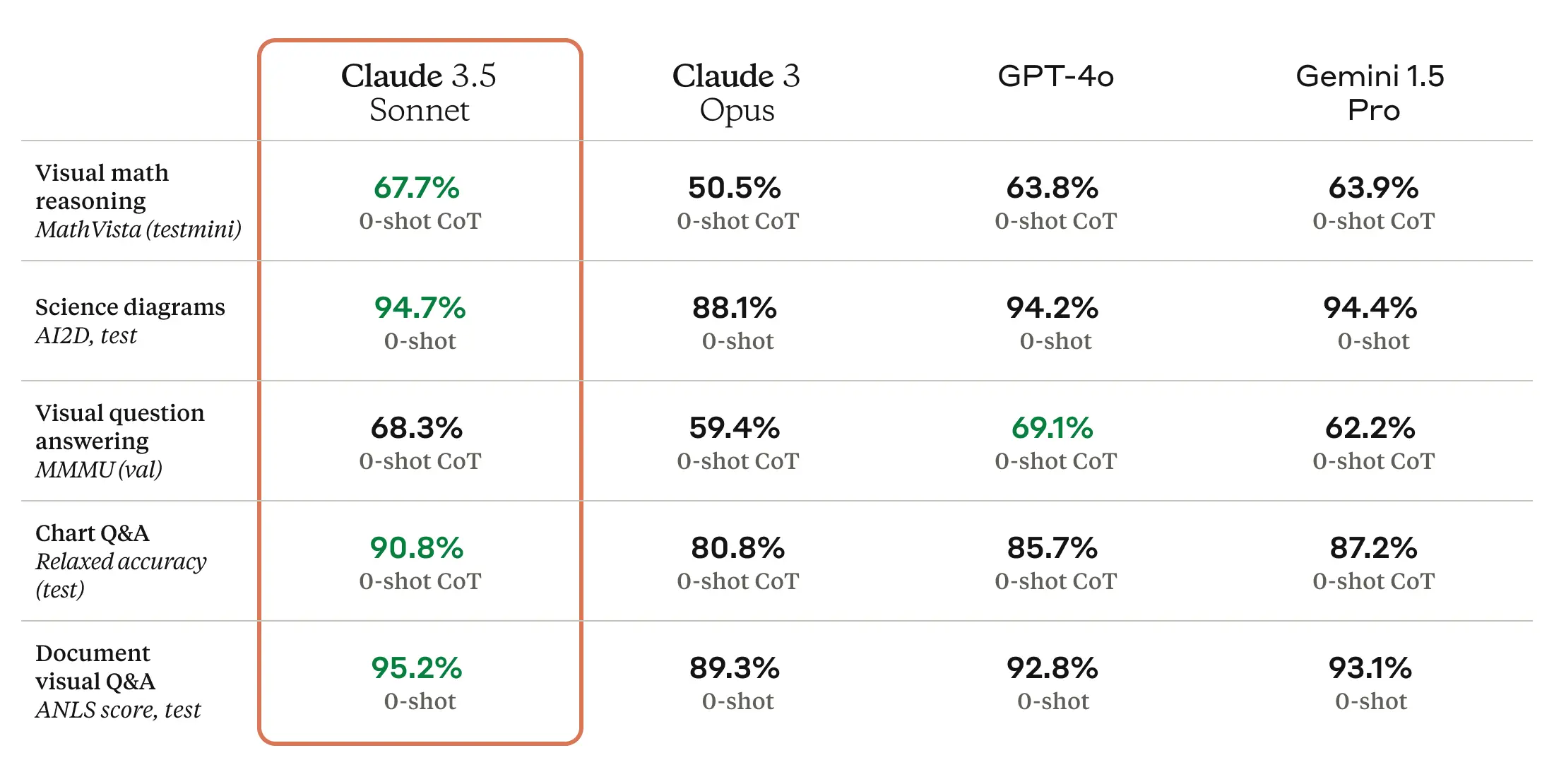

Sie sind und bleiben der größte Herausforderer der beiden AI-Riesen OpenAI/Microsoft und Google: Anthropic hat soeben sein neues AI-Modell „Claude 3.5 Sonnet“ veröffentlicht und gibt an, dass es in Sachen Reasoning, Coding, Mathematik, visueller Dokumentenverarbeitung oder Diagrammen besser als die Top-Modelle von OpenAI (GPT-4o) und Google (Gemini 1.5 Pro) sei.

Claude 3.5 Sonnet ist ab sofort kostenlos auf Claude.ai und in der Claude iOS App verfügbar, Abonnent:innen von Claude Pro- und Team-Tarifen dürfen mit „deutlich höheren Limits“ darauf zugreifen. Es ist auch über die Anthropic API, Amazon Bedrock und Vertex AI von Google Cloud verfügbar. Das Modell kostet 3 Dollar pro Million Input-Token und 15 Dollar pro Million Output-Token, mit einem Kontextfenster von 200K Token. Claude 3.5 Haiku und Claude 3.5 Opus sollen dann als kleinere bzw. größere Schwestern-Modelle im Laufe des Jahres folgen.

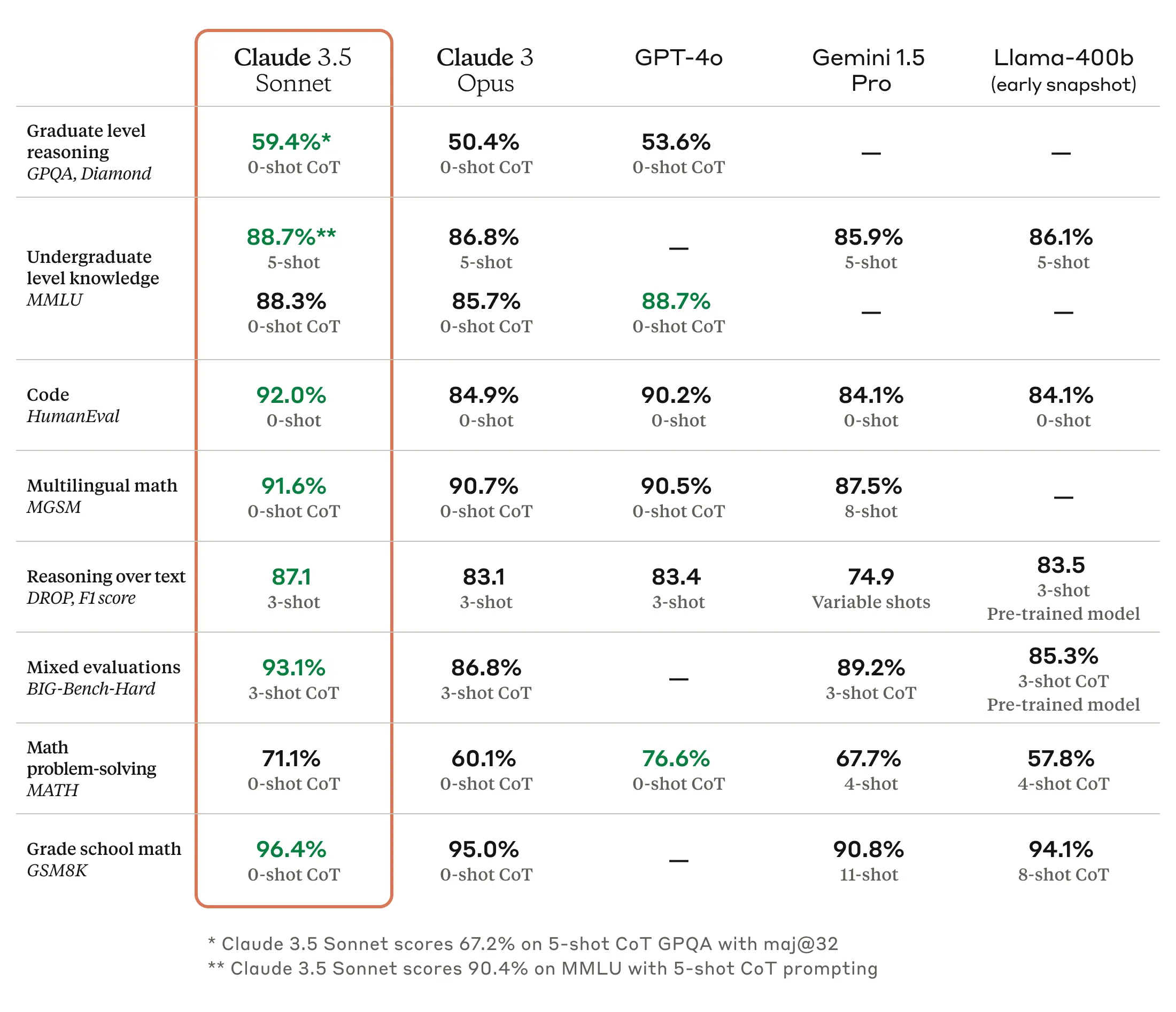

Hier die von Anthropic veröffentlichten Benchmark-Tests:

Anthropic: „Claude“ greift ChatGPT am iPhone und im Firmen-Sektor an

Mit Humor und Talent für komplexe Anweisungen

Wohl aber am wichtigsten, soll Anthropics neuestes AI-Modell auch sprachliche Stärken ausspielen: „Claude 3.5 Sonnet setzt neue Maßstäbe für das logische Denken von Hochschulabsolventen (GPQA), das Wissen von Hochschulabsolventen (MMLU) und die Codierungskompetenz (HumanEval). Es zeigt deutliche Verbesserungen beim Erfassen von Nuancen, Humor und komplexen Anweisungen und ist außergewöhnlich gut im Verfassen hochwertiger Inhalte mit einem natürlichen, verständlichen Ton“, heißt es in einer Aussendung.

Anthropic ist eine Abspaltung von OpenAI und wurde von ehemaligen Mitarbeiter:innen des ChatGPT-Machers gegründet. Bisher hat es mehr als 7 Milliarden Dollar an Kapital erhalten, die Großinvestoren heißen Amazon und Google. Auf die Fahnen schreibt man sich vor allem Sicherheit und Privatsphäre. „Wir trainieren unsere generativen Modelle nicht auf von Nutzern eingereichten Daten, es sei denn, ein Nutzer erteilt uns die ausdrückliche Erlaubnis dazu. Bislang haben wir keine von Kunden oder Nutzern übermittelten Daten zum Trainieren unserer generativen Modelle verwendet“, heißt es.