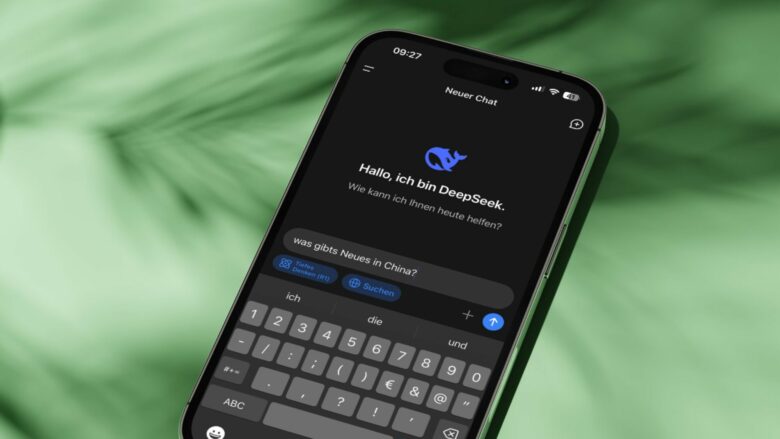

DeepSeek V3.1 ist da – und könnte die bislang leistungsstärkste Open-Source-AI sein

Das chinesische AI-Startup DeepSeek veröffentlichte am Dienstag still und heimlich sein bislang ambitioniertestes Modell: DeepSeek V3.1. Dabei handelt es sich um ein System mit 685 Milliarden Parametern, das die Dominanz der amerikanischen KI-Giganten herausfordert, berichtet VentureBeat. Die Open-Source-Zugänglichkeit macht das neue Modell besonders spannend.

V3.1 kann mit OpenAI und Anthropic mithalten

DeepSeek hat V3.1 ohne großes Aufsehen auf Hugging Face hochgeladen. Innerhalb weniger Stunden zeigten erste Leistungstests Benchmark-Ergebnisse, die mit den proprietären Systemen von OpenAI und Anthropic mithalten können. Darüber hinaus ermöglicht die Open-Source-Lizenz einen globalen Zugang ohne Einschränkungen durch geopolitische Spannungen.

Nur wenige Stunden nach seiner Einführung auf Hugging Face begann DeepSeek V3.1 in den Beliebtheitsrankings zu klettern. Das Modell erzielte beim renommierten Aider-Coding-Benchmark eine Punktzahl von 71,6 Prozent. Damit etablierte es sich als eines der leistungsstärksten verfügbaren Modelle. Das System verarbeitet bis zu 128.000 Token Kontext – was in etwa einem 400-seitigen Buch entspricht. Dabei erreicht es Antwortgeschwindigkeiten, die langsamere, auf Schlussfolgerungen basierende Konkurrenten in den Schatten stellen. Das Modell unterstützt mehrere Präzisionsformate, sodass Entwickler:innen die Leistung für ihre spezifischen Hardware-Einschränkungen optimieren können.

Angst vor AI-Blase ist zurück: Warnungen erschüttern US-Aktienmärkte

DeepSeek fordert US-Konkurrenz mit Open Source heraus

Der eigentliche Durchbruch liegt in der von DeepSeek als „hybride Architektur“ bezeichneten Struktur. Im Gegensatz zu früheren Versuchen, verschiedene KI-Fähigkeiten zu kombinieren, die oft zu Systemen führten, die in allen Bereichen schlechte Leistungen erbrachten, integriert V3.1 Chat-, Schlussfolgerungs- und Codierungsfunktionen nahtlos in ein einziges, kohärentes Modell. Auch beeindruckend ist die Effizienz des Modells. Mit etwa 1,01 US-Dollar pro vollständiger Codierungsaufgabe liefert V3.1 Ergebnisse, die mit Systemen vergleichbar sind, die fast 70 US-Dollar pro gleichwertiger Arbeitslast kosten.

DeepSeek hat einen sehr spezifischen Zeitpunkt für die Veröffentlichung gewählt. Die Einführung von V3.1 erfolgt nur wenige Wochen nach der Vorstellung von GPT-5 durch OpenAI und der Einführung von Claude 4 durch Anthropic. Beide sind als bahnbrechende Modelle positioniert, die den neuesten Stand der AI repräsentieren. Durch die Angleichung ihrer Leistung bei gleichzeitiger Beibehaltung der Open-Source-Zugänglichkeit stellt DeepSeek die grundlegenden Geschäftsmodelle, die der amerikanischen KI-Führungsrolle zugrunde liegen, direkt in Frage.

Für US-KI-Unternehmen ist DeepSeek eine potenziell große Herausforderung. Wenn Open-Source-Alternativen die Leistung proprietärer Lösungen erreichen und gleichzeitig mehr Flexibilität und geringere Kosten bieten, verschwinden die traditionellen Vorteile geschlossener Entwicklung. Unternehmen müssen einen erheblichen Mehrwert nachweisen, um Premium-Preise zu rechtfertigen.