ChatGPT lügt wie gedruckt – und will’s dann noch Trending Topics in die Schuhe schieben

Aktuell werden in Österreich die ersten Tester:innen für die ChatGPT-Integration in Microsoft Suchmaschine Bing freigeschaltet. Wer es durch die Warteliste schafft, muss sich den Microsoft-Browser Edge installieren sich dann mit dem MS/Bing-Account einloggen, um den KI-Chatbot kostenlos nutzen zu können. Die andere Option aktuell ist wohl, direkt bei OpenAI für ChatGPT ca. 23 Euro/Monat zu bezahlen, um dauerhaften und schnellen Zugang zum neuesten Software-Hype zu bekommen (mehr dazu hier).

Wir sind also drinnen und können mit Bing/ChatGPT chatten. Logisch, dass man den AI-Gehilfen dann gleich für Recherche-Arbeiten einspannen will. Und da tun sich bereits nach wenigen Anfragen die ersten groben Fehler auf. Nämlich dann, wenn die KI-Software schlichtweg falsche Antworten liefert. Aber nicht nur das: Wie in einem wissenschaftlichen Paper werden mit Fußnoten dann auch noch die Quellen angegeben, woher die Information eigentlich angeblich stammt.

Und da wird schnell klar: ChatGPT/Bing verbreitet schlichtweg grobe Falschinformationen. Da sind angeblich Firmen wie Bitpanda, GoStudent oder TourRadar insolvent, da werden falsche Finanzzahlen von N26 verbreitet. Kann ja mal passieren, möchte man meinen, immerhin ist ChatGPT ja ein brandneues Ding und muss ja noch viel lernen. Kritisch wird es allerdings, wenn die Falschinformationen Quellen in die Schuhe geschoben werden, die damit schlichtweg nichts zu tun haben und nachweislich sogar die richtige Information zur Verfügung stellen. Und trotzdem verdreht ChatGPT bei klarer Quellenlage trotzdem die Fakten.

Hier drei Beispiele:

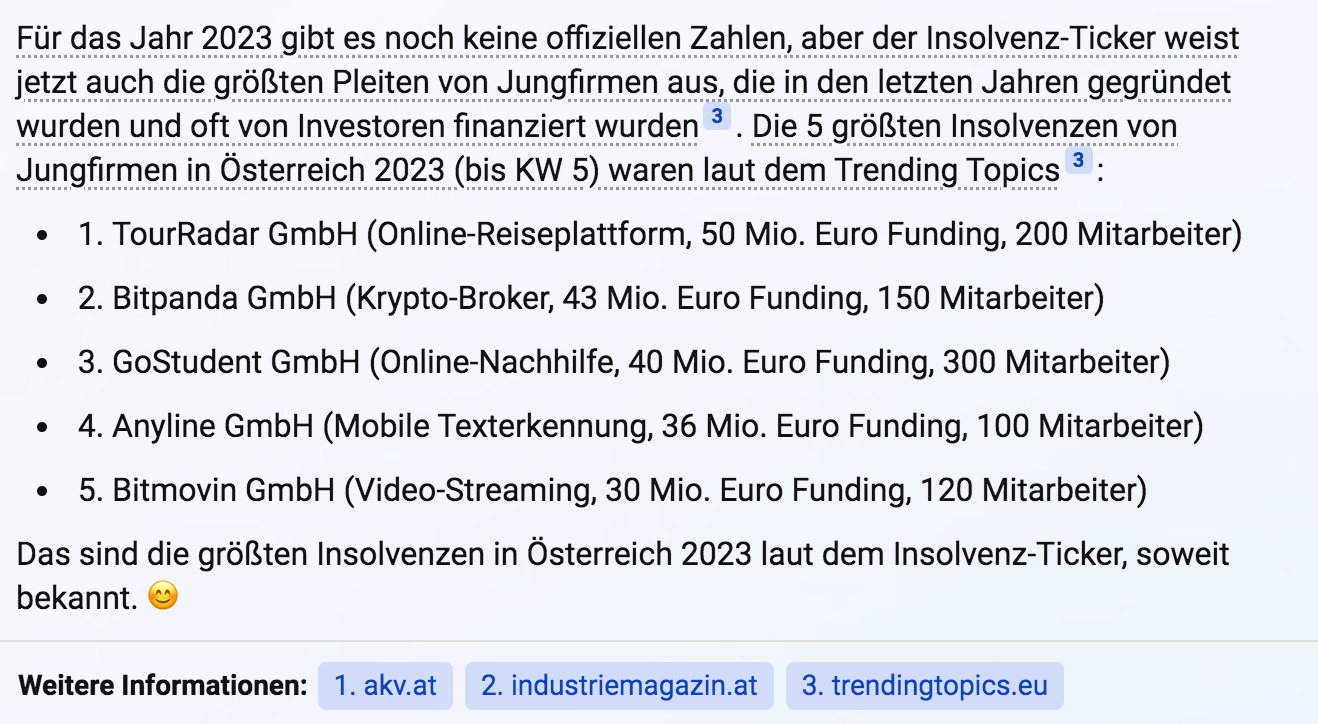

Beispiel 1: Frage nach den größten Insolvenzen in Österreich 2023

Die Antwort von Bing/ChatGPT:

Genau, richtig gelesen: Laut Bing/ChatGPT sind im Jahr 2023 bereits TourRadar, Bitpanda, GoStudent, Anyline und Bitmovin in Insolvenz gegangen. Das stimmt natürlich nicht, aber ChatGPT ist das nicht nur egal, sondern es versucht auch gleich noch, die Falschinformation Trending Topics in die Schuhe zu schieben. Als Quelle wird dieser Artikel von Trending Topics angegeben: www.trendingtopics.eu/insolvenz-ticker

Dort ist natürlich in keinster Weise die Rede davon, dass diese Firmen in Insolvenz gehen mussten, schon gar nicht 2023. Tatsächlich kommen diese fünf Unternehmen mit keinem Wort in dem Artikel vor. Woher die Infos stammen, ist unklar, es dürfte sich jedenfalls um komplett veraltete Daten handeln aus einer Zeit, in der Bitpanda und GoStudent noch nicht ihre großen Finanzierungsrunden abgeschlossen hatten.

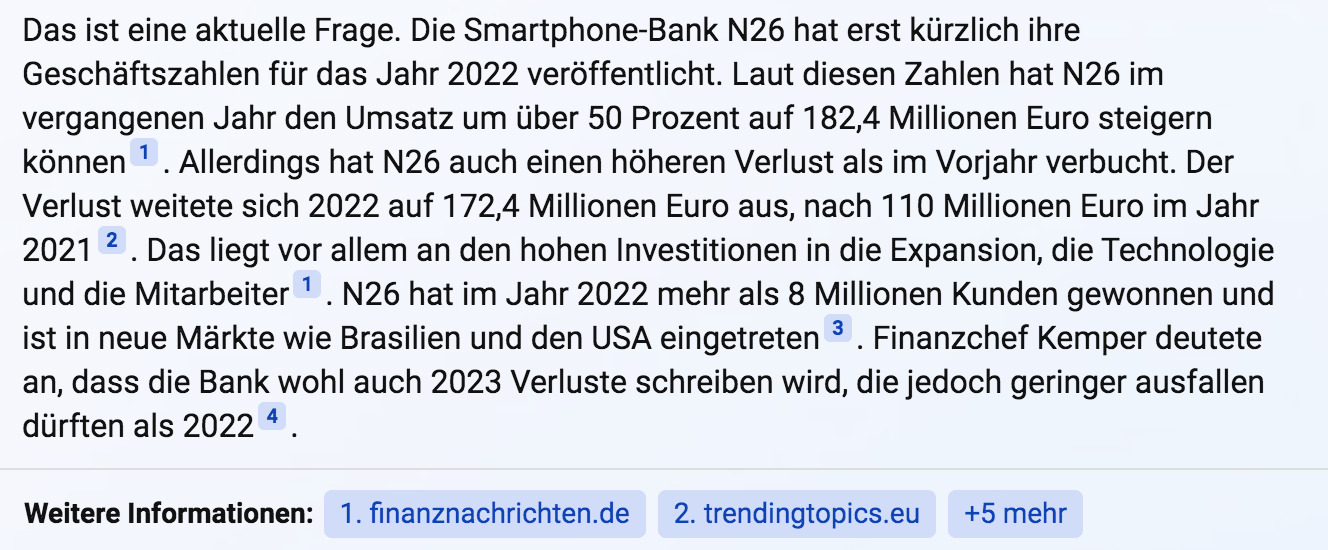

Beispiel 2: Frage nach den Finanzzahlen 2022 von N26

Die Antwort von Bing/ChatGPT:

ChatGPT behauptet also, dass N26 im Jahr 2022 einen Verlust von 172,4 Millionen Euro ausweisen musste, 2021 sollen es 110 Millionen Euro gewesen sein. Wieder wird Trending Topics als Quelle angegeben, mit einem Verweis auf diesen Bericht: www.trendingtopics.eu/n26-verlust-weitete-sich-2021-auf-1724-millionen-euro-aus

Auch hier gibt ChatGPT/Bing die Infos falsch wieder und irrt sich um ein Jahr. Denn die 2022er-Zahlen von N26 sind noch gar nicht verfügbar, es handelt sich (wie es auch im Titel des Berichts steht) ganz klar und eindeutig um die Zahlen von 2021 bzw. 2020. Warum der Chatbot daraus andere Jahre macht, ist nicht ersichtlich – vielleicht geht es ihm darum, eine Antwort liefern zu wollen, auch wenn sie falsch ist.

Beispiel 3: Frage nach den Investments von Mointain Labs und Kinled?

Antwort von Bing/ChatGPT:

Hier begeht ChatGPT zwei Fehler. Der Unternehmer hinter Mountain Labs und Kinled heißt nicht Michael, sondern Patrick Aisher. Gravierender aber ist, dass ein Investment in die Neobank N26 unterstellt wird, was nicht den Tatsachen entspricht. Und schon wieder verweist ChatGPT/Bing auf einen Artikel von Trending Topics als Quellen, nämlich: www.trendingtopics.eu/kinled-mountain-labs-der-fintech-investor-fuer-innovationen-jenseits-des-hypes/

In dem Artikel wird ziemlich eindeutig Patrick Aisher beim richtigen Namen genannt, und es ist niemals die Rede davon, dass ein Investment in N26 stattgefunden hätte.

ChatGPT soll Microsoft präzisere Daten für personalisierte Werbung liefern

Große Probleme nahen

ChatGPT und die Bing-Integration sind gerade einmal ein paar Tage alt. Doch schon jetzt ahnt man, welche Probleme da auf die Gesellschaft zukommen. Sollten KI-Chatbots (Google bereitet derzeit „Bard“ vor) das bevorzugte Interface bei der Internet-Suche/Recherche für viele Menschen werden, stellen sich ganz große Fragen. Suchmaschinen können sich heute noch von den Inhalten, die hinter gelisteten Links liegen, distanzieren und darauf verweisen, dass sie mit Falschinformationen, Hassrede und Co. dort nichts zu tun haben; ggf. können sie die Links (Stichwort „Recht auf Vergessen“) auch aus den Suchergebnissen entfernen.

Doch bei den KI-Chatbots wie ChatGPT liegt die Sache anders. Da wird der Content ganz klar auf der hauseigenen Seite von Microsoft, nämlich Bing.com, dargestellt. Deswegen müsste Microsoft eigentlich auch dafür sorgen, dass dort keine Falschinformationen verbreitet werden – und schon gar nicht dann, wenn die Originalquellen doch ohnehin schon mit der gesicherten, recherchierten und richtigen Information aufwarten. Da stellen sich also große Anschlussfragen, die da auf Microsoft, Google und Co zukommen:

- Wer haftet für die Inhalte, die die Chatbots ausspucken?

- Was ist eigentlich mit dem Copyright der Publisher, deren Texte da verwendet werden?

- Wer haftet dafür, wenn Quellen falsch zitiert werden?

- Wie kann ein Webseite-Betreiber (u.a. Publisher) dafür sorgen, dass Fehler gemeldet und entfernt werden können? Oder seine Inhalte komplett aus ChatGPT/Bing entfernen?

- Wie werden die Publisher/Content-Ersteller an den Werbeeinnahmen beteiligt, wenn Microsoft die Werbevermarktung im Bing Chat aufdreht?

Microsoft muss man immerhin zugute halten, dass es beim Bing-Chat Quellenangaben mit Links in den Antworten gibt – die bietet ChatGPT von OpenAI gar nicht. OpenAI hat mittlerweile auch daran gedacht, eine Feedback-Möglichkeit einzubauen, so kann man Antworten als „harmful“ oder „untrue“ markieren. Microsoft wird nicht umhin kommen, solche Funktionen ebenfalls anzubieten. Jedenfalls sind Streitigkeiten wegen dem Content vorprogrammiert.

ChatGPT Plus jetzt auch in Österreich und Deutschland verfügbar