Meta: So will Zuckerberg persönliche KI-Agenten für Milliarden User ermöglichen

Wenn man vorhat, jedem seiner User einen (kostenpflichtigen?) KI-Agenten zur Seite zu stellen, was braucht man dazu eigentlich? Genau: Riesige KI-Rechenzentren voller KI-Chips. Und zwar nicht nur, um die Modelle zu trainieren, sondern sie rund um die Uhr rechnen zu lassen. Wie sie genutzt werden sollen, ist auch schon klar: Und zwar durch die AR/KI-Brillen, die Meta seit geraumer Zeit etwa gemeinsam mit Ray-ban baut.

Meta Platforms hat deswegen zwei große Vereinbarungen mit den Chipherstellern AMD und Nvidia abgeschlossen, um seine KI-Infrastruktur massiv auszubauen. Die Deals verdeutlichen den enormen Kapitalbedarf der Tech-Giganten im Wettlauf um künstliche Intelligenz und zeigen gleichzeitig neue Finanzierungsmodelle in der Halbleiterindustrie.

AMD-Deal: Chips gegen Unternehmensanteile

Meta hat mit AMD eine mehrjährige Vereinbarung getroffen, die ein Gesamtvolumen im zweistelligen Milliardenbereich erreichen könnte. Der Social-Media-Konzern wird maßgeschneiderte Chips mit einer Gesamtkapazität von sechs Gigawatt erwerben. AMD-Chefin Lisa Su erklärte, dass jedes Gigawatt Rechenleistung einen Wert im zweistelligen Milliardenbereich habe.

Besonders ungewöhnlich ist die Struktur des Deals: AMD hat Meta eine leistungsbasierte Warrant ausgegeben, die dem Facebook-Konzern die Option gibt, bis zu 160 Millionen AMD-Aktien zu einem Ausübungspreis von nur 0,01 Dollar zu erwerben. Meta erhält diese Aktien in Tranchen, sobald bestimmte Prozessorbestellungen abgeschlossen sind. Die erste Tranche soll in der zweiten Jahreshälfte 2025 ausgehändigt werden, wenn das erste Gigawatt an Chips geliefert wird.

Die Warrant-Bedingungen sind an bestimmte Aktienkursschwellen gekoppelt, die bis zu 600 Dollar für die letzte Tranche reichen. Die Option läuft im Februar 2031 aus. Sollte Meta alle Tranchen ausüben, könnte der Konzern einen Anteil von bis zu zehn Prozent an AMD halten. AMD-Aktien stiegen nach Bekanntgabe des Deals um bis zu 14 Prozent und gaben dem Unternehmen eine Marktkapitalisierung von 342 Milliarden Dollar.

Nvidia-Vereinbarung: Millionen Chips über mehrere Jahre

Parallel zum AMD-Deal hat Meta auch eine langfristige Liefervereinbarung mit dem Marktführer Nvidia abgeschlossen. Der Vertrag umfasst die Lieferung von Millionen KI-Chips über mehrere Jahre hinweg. Branchenanalysten schätzen den Gesamtwert dieser Vereinbarung auf rund 50 Milliarden Dollar.

Das Abkommen beinhaltet sowohl die aktuelle Blackwell-Architektur als auch die kommende Rubin-Generation von KI-Beschleunigern. Darüber hinaus liefert Nvidia eigenständige Installationen seiner Grace- und Vera-Zentralprozessoren, die auf ARM-Technologie basieren. Diese CPUs sollen bei bestimmten Aufgaben einen um die Hälfte reduzierten Stromverbrauch ermöglichen.

Meta zählt zu den vier größten Kunden, die im jüngsten Geschäftsquartal etwa 61 Prozent der Nvidia-Umsätze ausmachten. Die Ankündigung erfolgte strategisch eine Woche vor der Veröffentlichung von Nvidias Quartalszahlen.

Diversifizierung der Lieferkette

Santosh Janardhan, Metas Infrastruktur-Chef, betonte die Strategie der Diversifizierung: „Wir glauben nicht, dass eine einzige Siliziumlösung für alle unsere Workloads funktionieren wird. Es gibt einen Platz für Nvidia, es gibt einen Platz für AMD und es gibt einen Platz für unsere eigene maßgeschneiderte Siliziumtechnologie. Wir brauchen alle drei.“

Die AMD-Chips, eine angepasste Version der MI450-Serie, sollen hauptsächlich für Inferenz-Workloads eingesetzt werden, also für den Betrieb von KI-Modellen nach deren Training. Die benötigten sechs Gigawatt Strom entsprechen dem jährlichen Verbrauch von fünf Millionen US-Haushalten.

Meta-Tochter Manus als erster Schritt in Richtung KI-Agenten

Welche Services im Bereich KI-Agenten könnte Meta letztlich planen? Einen Vorgeschmack darauf gibt es schon: Die Meta-Tochter Manus, erst Ende Dezember 2025 für rund zwei Milliarden Dollar übernommen, greift nun aktiv in den wachsenden Markt für KI-Agenten ein.

Mit dem neuen Dienst „Manus Agents“ bringt das chinesisch-singapurische Unternehmen vollwertige KI-Fähigkeiten direkt in Messaging-Plattformen – gestartet wird auf Telegram, WhatsApp und weitere Dienste wie Slack, LINE und Discord sollen in den nächsten Wochen folgen. Anders als klassische Chatbots verfügt das System über ein dauerhaftes Gedächtnis, lernt Schreibstil und Präferenzen seiner Nutzer und führt mehrstufige Aufgaben selbstständig aus – von der Präsentationserstellung bis zur Kalenderverwaltung über verknüpfte Dienste wie Gmail oder Notion.

Die strategische Stoßrichtung ist klar: Manus positioniert sich als niedrigschwellige Alternative zu Angeboten wie OpenClaw, das für viele Nutzer mit komplexer Einrichtung und unvorhersehbaren Kosten verbunden ist. Für die nächsten dreißig Tage hat ein Mitgründer weitreichende Erweiterungen angekündigt – darunter spezialisierte Agenten für Gruppenchats, native Apps für Windows und Mac sowie eine Funktion, die es der KI erlaubt, den Computer des Nutzers direkt zu bedienen.

Rekordinvestitionen in KI-Infrastruktur

Meta plant, seine Ausgaben für KI-Infrastruktur im laufenden Jahr auf bis zu 135 Milliarden Dollar nahezu zu verdoppeln. Um diese massiven Investitionen zu finanzieren, hat das Unternehmen im Oktober 2024 Anleihen im Wert von 30 Milliarden Dollar ausgegeben, die größte Anleiheemission in der Unternehmensgeschichte.

Meta-Chef Mark Zuckerberg formulierte das ambitionierte Ziel, mit der bestellten Technologie jedem Menschen auf der Welt persönliche Superintelligenz bereitzustellen. Das Unternehmen ist mit seinen eigenen KI-Modellen jedoch deutlich hinter die Konkurrenz zurückgefallen und könnte den mit Llama eingeschlagenen Pfad der offenen Large Language Models verlassen wollen.

Das Hyperion-Projekt: 30 Milliarden Dollar für Louisiana

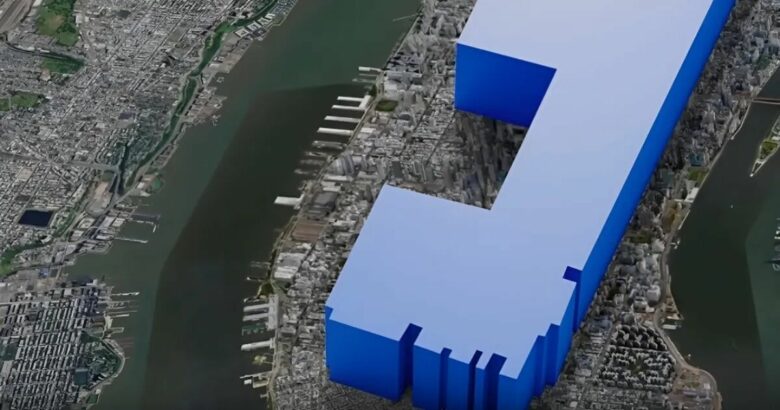

Parallel zu den Chip-Deals treibt Meta den Bau eines gigantischen Rechenzentrums voran. In Holly Ridge im US-Bundesstaat Louisiana entsteht das Projekt „Hyperion“, ein KI-optimiertes Datenzentrum mit einem Investitionsvolumen von etwa 30 Milliarden Dollar. Die Anlage soll eine Fläche erreichen, die einem Viertel von Manhattan entspricht.

Ungewöhnliche Finanzierungsstruktur

Die Finanzierung von Hyperion erfolgt über eine komplexe Konstruktion, die Bedenken über mögliche Blasenbildung im KI-Sektor ausgelöst hat. Meta arbeitet dabei mit der Private-Credit-Firma Blue Owl Capital zusammen. Die Eigentumsstruktur ist wie folgt aufgeteilt:

- Meta hält 20 Prozent der Anteile am Rechenzentrum

- Blue Owl Capital besitzt die restlichen 80 Prozent

- Blue Owl übernimmt den Großteil der Fremdfinanzierung

- Die Schulden erscheinen nicht in Metas Bilanz

Blue Owl hat für das Projekt eine eigene juristische Einheit namens Beignet Investor LLC gegründet, die Anleihen im Wert von 27 Milliarden Dollar an Wall-Street-Investoren verkauft hat. Die Rückzahlung dieser Anleihen soll durch Mieteinnahmen erfolgen, da Meta das Rechenzentrum least.

Energieversorgung als limitierender Faktor

Der enorme Stromverbrauch der geplanten Rechenzentren entwickelt sich zunehmend zum begrenzenden Faktor. Erste US-Bundesstaaten erwägen bereits Beschränkungen für neue Datenzentren. US-Präsident Trump mahnte KI-Unternehmen zuletzt, eigene Stromversorgung unabhängig von den öffentlichen Netzen zu bauen.

Meta betont, die größte KI-Infrastruktur weltweit aufbauen zu wollen und dabei auf energieeffiziente Technologie zu setzen, um die Leistung pro Watt deutlich zu steigern.

Die Hyperion-Anlage allein würde enorme Mengen an Strom benötigen. Neben den Prozessoren hat Meta auch umfangreiche Mengen an Ethernet-Switches bei Nvidia geordert, um die Vernetzung seiner Rechenzentren zu optimieren.

Hintergrund: Führungswechsel bei Meta AI

Die aggressive Investitionsstrategie hat auch zu personellen Veränderungen geführt. Yann LeCun, langjähriger KI-Chef von Meta, hat das Unternehmen verlassen. LeCun vertritt die Ansicht, dass man mit den aktuellen Transformer-Modellen nicht in Richtung Superintelligenz gelangen wird und stattdessen World Models auf Basis einer anderen Architektur entwickeln muss. Er hat mit AMI Labs ein entsprechendes Startup gegründet.

Meta hingegen ist zu der Überzeugung gekommen, dass deutlich mehr Rechenleistung notwendig ist, um KI-Modelle zu verbessern. Ein weiterer Faktor ist die Inferenz: Wenn Milliarden Nutzer weltweit täglich mehrmals Meta AI verwenden, benötigt das Unternehmen entsprechende Rechenkraft für die Verarbeitung.